环境

- 服务器信息,是腾讯云服务器,2核cpu,4GB内存,80GB云硬盘,系统为centos 7.6_x64

介绍

Hadoop是用来处理大数据集合的分布式存储计算基础架构。可以使用一种简单的编程模式,通过多台计算机构成的集群,分布式处理大数据集。hadoop作为底层,其生态环境很丰富。hadoop基础包括以下四个基本模块:

- hadoop基础功能库:支持其他hadoop模块的通用程序包。

- HDFS: 一个分布式文件系统,能够以高吞吐量访问应用的数据。

- YARN: 一个作业调度和资源管理框架。

- MapReduce: 一个基于YARN的大数据并行处理程序。

安装配置

创建hadoop用户

1 | su # root 用户登录 |

设置权限

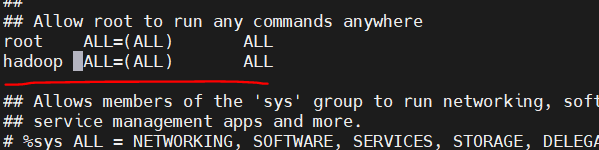

为 hadoop 用户增加管理员权限,方便部署,避免一些对新手来说比较棘手的权限问题,输入命令

visudo1

2[hadoop@VM-24-13-centos hadoop]$ sudo visudo

[sudo] password for hadoop:找到

root ALL=(ALL) ALL这行,然后在这行下面增加一行内容:hadoop ALL=(ALL) ALL(当中的间隔为tab),如下图所示:

su hadoop直接可以切换用户

安装SSH、配置SSH无密码登陆

集群、单节点模式都需要用到 SSH 登陆(类似于远程登陆,你可以登录某台 Linux 主机,并且在上面运行命令),一般情况下,CentOS 默认已安装了 SSH client、SSH server,打开终端执行如下命令进行检验:

1

2

3

4

5

6[hadoop@VM-24-13-centos /]$ rpm -qa | grep ssh

openssh-7.4p1-21.el7.x86_64

openssh-clients-7.4p1-21.el7.x86_64

openssh-server-7.4p1-21.el7.x86_64

libssh2-1.8.0-4.el7.x86_64- 包含了 SSH client 跟 SSH server,则不需要再安装

接着执行如下命令(

ssh localhost)测试一下 SSH 是否可用:1

2

3

4

5

6

7

[hadoop@VM-24-13-centos /]$ ssh localhost

The authenticity of host 'localhost (::1)' can't be established.

ECDSA key fingerprint is SHA256:v9LOJv5al8BNRGGZVJeqa2AdV3znIsa6cjyoj9CbWRQ.

ECDSA key fingerprint is MD5:bd:51:9d:6f:1f:9c:1f:ad:34:ce:fb:90:4f:27:bc:b1.

Are you sure you want to continue connecting (yes/no)? yes此时会有如下提示(SSH首次登陆提示),输入 yes 。然后按提示输入密码 hadoop,这样就登陆到本机了,类似于下面这样:

1

2

3

4

5Warning: Permanently added 'localhost' (ECDSA) to the list of known hosts.

hadoop@localhost's password:

Last login: Tue Dec 7 09:37:37 2021

[hadoop@VM-24-13-centos ~]$

但这样登陆是需要每次输入密码的,我们需要配置成SSH无密码登陆比较方便。

首先输入

exit退出刚才的 ssh,就回到了我们原先的终端窗口,1

2

3

4

5

6

[hadoop@VM-24-13-centos ~]$ exit

logout

Connection to localhost closed.

[hadoop@VM-24-13-centos /]$然后利用 ssh-keygen 生成密钥,并将密钥加入到授权中

1

2

3

4cd ~/.ssh/ # 若没有该目录,请先执行一次ssh localhost

ssh-keygen -t rsa # 会有提示,都按回车就可以

cat id_rsa.pub >> authorized_keys # 加入授权

chmod 600 ./authorized_keys # 修改文件权限~的含义

在 Linux 系统中,~ 代表的是用户的主文件夹,即 “/home/用户名” 这个目录,如你的用户名为 hadoop,则 ~ 就代表 “/home/hadoop/”。 此外,命令中的 # 后面的文字是注释。

此时再用

ssh localhost命令,无需输入密码就可以直接登陆了,如下所示。

1 | hadoop@VM-24-13-centos .ssh]$ ssh localhost |

java

java之前已经装好了,为1.8

1

2

3

4

5

[hadoop@VM-24-13-centos ~]$ java -version

java version "1.8.0_311"

Java(TM) SE Runtime Environment (build 1.8.0_311-b11)

Java HotSpot(TM) 64-Bit Server VM (build 25.311-b11, mixed mode)

安装hadoop

- 安装hadoop版本为3.0

1 | su root |

Hadoop 解压后即可使用。输入如下命令来检查 Hadoop 是否可用,成功则会显示 Hadoop 版本信息:

1

2

3

4

5

6

7

8

9

10

11cd /usr/local/hadoop

./bin/hadoop version

[hadoop@VM-24-13-centos hadoop]$ ./bin/hadoop version

Hadoop 3.0.3

Source code repository https://yjzhangal@git-wip-us.apache.org/repos/asf/hadoop.git -r 37fd7d752db73d984dc31e0cdfd590d252f5e075

Compiled by yzhang on 2018-05-31T17:12Z

Compiled with protoc 2.5.0

From source with checksum 736cdcefa911261ad56d2d120bf1fa

This command was run using /usr/local/hadoop/share/hadoop/common/hadoop-common-3.0.3.jar

Hadoop单机配置(非分布式)

- Hadoop 默认模式为非分布式模式,无需进行其他配置即可运行。非分布式即单 Java 进程,方便进行调试。

- 这里比较奇怪,安装原文中教程,示例已经验证通过了,当搭建了伪分布式配置时,第二天运行这里的实例,没有成功?然后把实例修改后,发现居然和伪分布式配置代码差不多?暂不做深究了

实例

现在我们可以执行例子来感受下 Hadoop 的运行。Hadoop 附带了丰富的例子(运行

./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-3.0.3.jar可以看到所有例子),包括 wordcount、terasort、join、grep 等。在此我们选择运行 wordcount例子,我们将 input 文件夹中的所有文件作为输入,最后输出结果到 output 文件夹中。

1 | cd /usr/local/hadoop |

注意,Hadoop 默认不会覆盖结果文件,因此再次运行上面实例会提示出错,需要先将

./output删除。1

[hadoop@VM-24-13-centos hadoop]$ hdfs dfs -rm -r /usr/local/hadoop/output

Hadoop伪分布式配置

- Hadoop 可以在单节点上以伪分布式的方式运行,Hadoop 进程以分离的 Java 进程来运行,节点既作为 NameNode 也作为 DataNode,同时读取的是 HDFS 中的文件。

设置环境变量

- 在设置 Hadoop 伪分布式配置前,我们还需要设置 HADOOP 环境变量,执行如下命令在 ~/.bashrc 中设置:

1 | vi ~/.bashrc |

生效环境变量

source ~/.bashrc修改Hadoop-env.sh中的java_home,不然在启动集群(伪集群)时出现报错

1

2

3

4

5sudo vi /usr/local/hadoop/etc/hadoop/hadoop-env.sh

# 设置如下

export JAVA_HOME=/usr/local/jdk1.8.0_311

配置文件

Hadoop 的配置文件位于

/usr/local/hadoop/etc/hadoop/中,伪分布式需要修改2个配置文件 core-site.xml 和 hdfs-site.xmlHadoop的配置文件是 xml 格式,每个配置以声明 property 的 name 和 value 的方式来实现。

修改配置文件 core-site.xml

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15sudo vi /usr/local/hadoop/etc/hadoop/core-site.xml

<configuration>

<property>

<name>hadoop.tmp.dir</name>

<value>file:/usr/local/hadoop/tmp</value>

<description>Abase for other temporary directories.</description>

</property>

# 设置HDFS的默认名称,在使用命令调用时,可以用此名称

<property>

<name>fs.defaultFS</name>

<value>hdfs://localhost:9000</value>

</property>

</configuration>同样的,修改配置文件 hdfs-site.xml:

1

2

3

4

5

6

7

8

9

10

11

12

13

14

15

16

17

18<configuration>

<property>

<name>dfs.replication</name>

<value>1</value>

<description>设置blocks副本数</description>

</property>

<property>

<name>dfs.namenode.name.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/name</value>

<description>设置存放NameNode的数据存储目录</description>

</property>

<property>

<name>dfs.datanode.data.dir</name>

<value>file:/usr/local/hadoop/tmp/dfs/data</value>

<description>设置存放DataNode的数据存储目录</description>

</property>

</configuration>配置完成后,执行 NameNode 的格式化:

1

./bin/hdfs namenode -format

接着开启

NaneNode和DataNode守护进程,./sbin/start-dfs.sh1

2

3

4

5[hadoop@VM-24-13-centos hadoop]$ ./sbin/start-dfs.sh

Starting namenodes on [localhost]

Starting datanodes

Starting secondary namenodes [VM-24-13-centos]启动完成后,可以通过命令

jps来判断是否成功启动,若成功启动则会列出如下进程:NameNode、DataNode和SecondaryNameNode(如果 SecondaryNameNode 没有启动,请运行 sbin/stop-dfs.sh 关闭进程,然后再次尝试启动尝试)。如果没有 NameNode 或 DataNode ,那就是配置不成功,请仔细检查之前步骤,或通过查看启动日志排查原因。

1 |

|

通过查看启动日志分析启动失败原因

有时 Hadoop 无法正确启动,如 NameNode 进程没有顺利启动,这时可以查看启动日志来排查原因,注意几点:

- 启动时会提示形如 “dblab: starting namenode, logging to /usr/local/hadoop/logs/hadoop-hadoop-namenode-dblab.out”,其中 dblab 对应你的主机名,但启动的日志信息是记录在 /usr/local/hadoop/logs/hadoop-hadoop-namenode-dblab.log 中,所以应该查看这个后缀为 .log 的文件;

- 每一次的启动日志都是追加在日志文件之后,所以得拉到最后面看,看下记录的时间就知道了。

- 一般出错的提示在最后面,也就是写着 Fatal、Error 或者 Java Exception 的地方。

- 可以在网上搜索一下出错信息,看能否找到一些相关的解决方法。

实例

上面的单机模式,grep 例子读取的是本地数据,伪分布式读取的则是 HDFS 上的数据。要使用 HDFS,首先需要在 HDFS 中创建用户目录:

1

2[hadoop@VM-24-13-centos hadoop]$ ./bin/hdfs dfs -mkdir -p /user/hadoop

2021-12-07 16:25:32,492 WARN util.NativeCodeLoader: Unable to load native-hadoop library for your platform... using builtin-java classes where applicable接着将·

./etc/hadoop中的 xml 文件作为输入文件复制到分布式文件系统中,即将/usr/local/hadoop/etc/hadoop复制到分布式文件系统中的/user/hadoop/input中。我们使用的是 hadoop 用户,并且已创建相应的用户目录/user/hadoop,因此在命令中就可以使用相对路径如 input,其对应的绝对路径就是/user/hadoop/input

1 | ./bin/hdfs dfs -mkdir input |

复制完成后,可以通过如下命令查看 HDFS 中的文件列表:

1

2

3

4

5

6

7

8

9

10

11

12[hadoop@VM-24-13-centos hadoop]$ ./bin/hdfs dfs -ls input

Found 9 items

-rw-r--r-- 1 hadoop supergroup 7861 2021-12-07 16:28 input/capacity-scheduler.xml

-rw-r--r-- 1 hadoop supergroup 1071 2021-12-07 16:28 input/core-site.xml

-rw-r--r-- 1 hadoop supergroup 10206 2021-12-07 16:28 input/hadoop-policy.xml

-rw-r--r-- 1 hadoop supergroup 1339 2021-12-07 16:28 input/hdfs-site.xml

-rw-r--r-- 1 hadoop supergroup 620 2021-12-07 16:28 input/httpfs-site.xml

-rw-r--r-- 1 hadoop supergroup 3518 2021-12-07 16:28 input/kms-acls.xml

-rw-r--r-- 1 hadoop supergroup 682 2021-12-07 16:28 input/kms-site.xml

-rw-r--r-- 1 hadoop supergroup 758 2021-12-07 16:28 input/mapred-site.xml

-rw-r--r-- 1 hadoop supergroup 690 2021-12-07 16:28 input/yarn-site.xml伪分布式运行 MapReduce 作业的方式跟单机模式相同,区别在于伪分布式读取的是HDFS中的文件(可以将单机步骤中创建的本地 input 文件夹,输出结果 output 文件夹都删掉来验证这一点)。

1

2

3

4

5[hadoop@VM-24-13-centos hadoop]$ ./bin/hadoop jar ./share/hadoop/mapreduce/hadoop-mapreduce-examples-*.jar wordcount input output

....

2021-12-07 16:30:56,021 INFO mapreduce.Job: Job job_local897809468_0002 completed successfully

...查看运行结果的命令(查看的是位于 HDFS 中的输出结果):

1

2

3

4

5

6

7

8[hadoop@VM-24-13-centos hadoop]$ ./bin/hdfs dfs -ls output/*

-rw-r--r-- 1 hadoop supergroup 0 2021-12-10 17:58 output/_SUCCESS

-rw-r--r-- 1 hadoop supergroup 9405 2021-12-10 17:58 output/part-r-00000

[hadoop@VM-24-13-centos hadoop]$ ./bin/hdfs dfs -cat output/part-r-00000

....我们也可以将运行结果取回到本地:

1

2

3

4

5

6rm -r ./output # 先删除本地的 output 文件夹(如果存在)

./bin/hdfs dfs -get output ./output # 将 HDFS 上的 output 文件夹拷贝到本机

[hadoop@VM-24-13-centos hadoop]$ cat ./output/*

.....Hadoop 运行程序时,输出目录不能存在,否则会提示错误

org.apache.hadoop.mapred.FileAlreadyExistsException: Output directory hdfs://localhost:9000/user/hadoop/output already exists,因此若要再次执行,需要执行如下命令删除 output 文件夹:

1 | ./bin/hdfs dfs -rm -r output # 删除 output 文件夹 |

- 为防止覆盖结果,程序指定的输出目录(如 output)不能存在,否则会提示错误,运行前需要先删除输出目录。在实际开发应用程序时,可考虑在程序中加上如下代码,能在每次运行时自动删除输出目录,避免繁琐的命令行操作,可以采用类似于下面java代码:

1 | Configuration conf = new Configuration(); |

若要关闭 Hadoop,则运行

1

./sbin/stop-dfs.sh

下次启动 hadoop 时,无需进行 NameNode 的初始化,只需要运行

./sbin/start-dfs.sh就可以!

完全分布式

后续打算采用本地三台虚拟机的模式搭建完全分布式。

请注意分布式运行中的这几个结点的区别:

- 从分布式存储的角度来说,集群中的结点由一个NameNode和若干个DataNode组成,另有一个SecondaryNameNode作为NameNode的备份。

- 从分布式应用的角度来说,集群中的结点由一个JobTracker和若干个TaskTracker组成,JobTracker负责任务的调度,TaskTracker负责并行执行任务。TaskTracker必须运行在DataNode上,这样便于数据的本地计算。JobTracker和NameNode则无须在同一台机器上。一个机器上,既当namenode,又当datanode,或者说 既 是jobtracker,又是tasktracker。没有所谓的在多台机器上进行真正的分布式计算,故称为”伪分布式”。

- 真正的分布式,由3个及以上的实体机或者虚拟机组件的机群。

- 来自这里